我不知是否

领会了你的意思:若真领会,

它便浮于你声音的字词涟漪之上,

如同溪流中黄昏的淡淡倒影。托马斯·洛弗尔·贝多斯,1851年

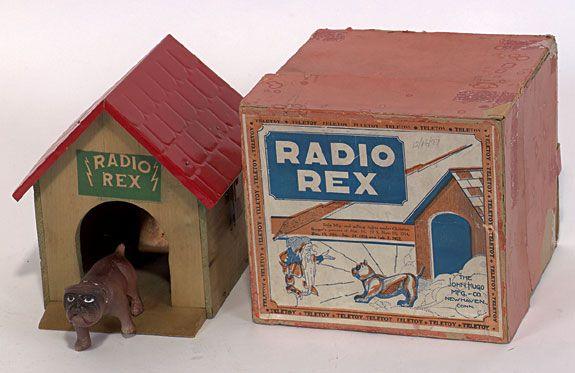

理解口语,或至少将其中的词语转写为文字,是计算机语言处理最早的目标之一。 事实上,语音处理的历史比计算机还要早几十年! 最早的语音识别机器出现在 20 世纪 20 年代,那是一个玩具。 右侧所示的“Radio Rex”是一只赛璐珞制成的狗。当接收到约500 Hz的声能时,它内部的弹簧会被释放,从而驱动狗移动。 由于 500 Hz 大致对应“Rex”一词中元音[eh]的第一共振峰,因此这只狗似乎真的会在被叫到名字时出现(David, Jr. 与 Selfridge,1962)。

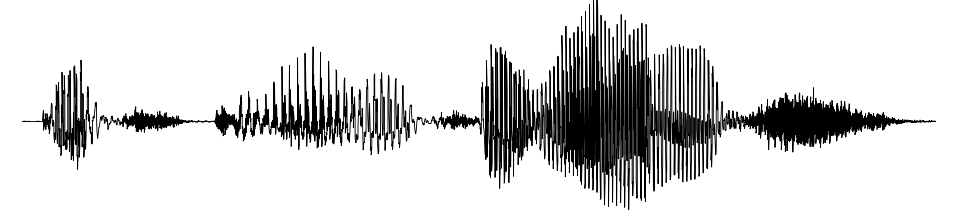

在现代,我们对自动系统提出了更高要求。 自动语音识别(ASR)的任务,就是将如下这样的声波:

映射为对应的词串:

It's time for lunch!

目前,要实现任意说话人、在任意环境下都能准确转录语音,这一目标仍远未达成。但ASR技术已经发展成熟,足以胜任许多实际任务。 语音是一种自然的人机交互方式,特别适用于操控家电,或与数字助理、聊天机器人交流。在手机等设备上尤其如此,因为键盘输入往往不够便捷。 ASR也广泛用于通用转录场景,例如自动生成音视频内容的字幕(如电影、视频或实时讨论的转录)。 在法律等领域,口述转录具有重要作用。 此外,ASR还是增强型通信的关键组成部分。这类通信指计算机与存在某些障碍的人类用户之间的互动——这些障碍可能导致用户难以或无法打字,或存在听觉困难。 失明的弥尔顿曾口述《失乐园》由女儿记录;亨利·詹姆斯则因重复性劳损,在后期改用口述创作小说。

接下来几节将介绍ASR任务的不同目标,说明如何提取声学特征,并引入卷积神经网络架构。该架构常被用作语音识别任务的初始层。

随后,我们将介绍两类ASR方法。 第一类是编码器-解码器范式。我们会介绍基于注意力机制的基础编码器-解码器算法,早期实现常被称为“Listen Attend and Spell”。 我们还会介绍一种更先进的编码器-解码器系统——OpenAI 的 Whisper 系统(Radford 等,2023),以及一个采用相同架构的开源系统 OWSM(Open Whisper-style Speech Model)(Peng 等,2023)。(这些模型还具备翻译等额外能力,后文将详述。) 第二类方法利用自监督语音模型(有时缩写为 SSL,即自监督学习),例如 Wav2Vec2.0或 HuBERT。这些模型作为编码器,能够学习语音的抽象表示。通过与 CTC(连接时序分类)损失函数结合用于解码,即可完成 ASR 任务。

最后,我们将介绍评估ASR性能的标准指标——词错误率(word error rate)。